Як відрізнити справжнє відео від діпфейка: прості ознаки ШІ-контенту

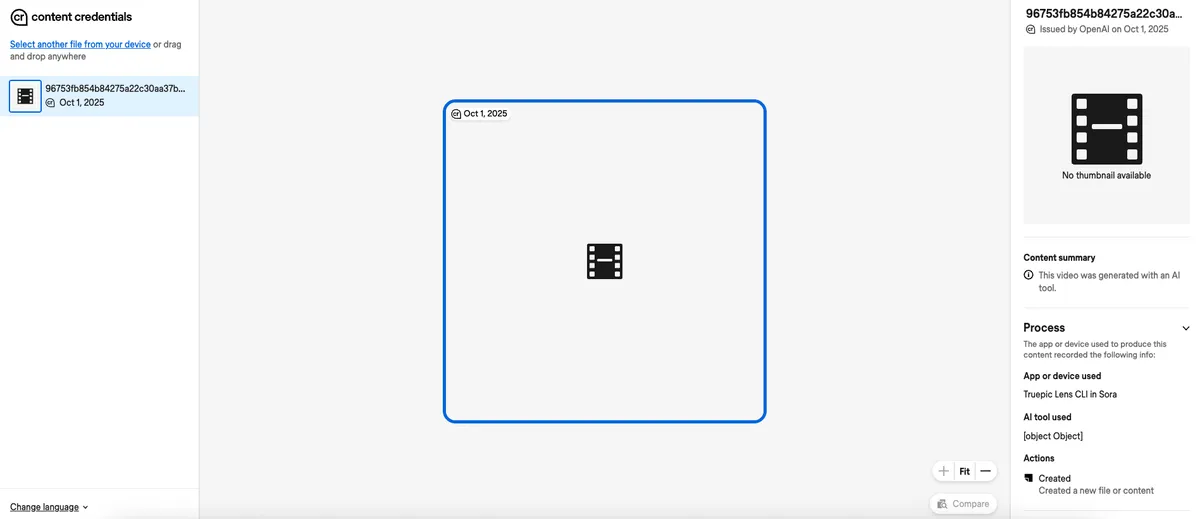

- Перейдіть на сайт verify.contentauthenticity.org

- Завантажте фото, відео або документ

- Натисніть "Відкрити"

- Вивчіть інформацію в правій панелі - якщо контент створений ШІ, це буде вказано в описі.

Інструмент Content Authenticity Initiative (фото: CNET)

Обмеження методу

Як і будь-які детектори ШІ, цей інструмент не ідеальний. Відео, створені іншими сервісами, наприклад Midjourney, можуть не містити потрібних метаданих. Крім того, якщо ролик Sora був оброблений стороннім додатком і повторно збережений, ймовірність його коректного розпізнавання знижується.

Проте перевірка метаданих залишається одним із найефективніших способів відрізнити реальне відео від діпфейка в епоху стрімкого розвитку ШІ.

Шукайте маркування ШІ і вказуйте його самостійно

У соціальних мережах компанії Meta - таких як Instagram і Facebook - користувачі можуть отримати додаткову підказку про те, чи є контент згенерованим ШІ. У Meta є внутрішні системи, які відзначають подібні матеріали спеціальними мітками. Ці механізми не ідеальні, але у позначених публікацій можна побачити відповідну позначку. Аналогічні правила маркування ШІ-контенту діють і на платформах TikTok і YouTube.

При цьому єдиний по-справжньому надійний спосіб зрозуміти, що контент створений штучним інтелектом, - це пряма вказівка автора. Багато соцмереж уже пропонують налаштування, що дають змогу позначати публікації як згенеровані ШІ. Навіть просте пояснення в підписі до посту допомагає аудиторії зрозуміти, яким чином було створено матеріал.

Поки користувач гортає стрічку Sora, він розуміє, що перед ним - вигадка. Однак після виходу за межі застосунку і публікації АІ-відео на інших платформах відповідальність за розкриття походження контенту стає спільною.

У міру того як такі моделі, як Sora, дедалі сильніше стирають межу між реальністю і вигаданим, саме користувачі повинні робити максимально прозорим походження відео - реальне воно чи створене ШІ.

Головне - зберігати пильність

Не існує універсального способу з першого погляду точно визначити, чи є відео реальним, чи згенерованим ШІ. Найкраще, що можна зробити, - не вірити беззастережно всьому, що ви бачите в інтернеті. Якщо щось здається підозрілим або "неприродним", найімовірніше, так воно і є.

В умовах, коли мережа заповнюється ШІ-контентом сумнівної якості, найкращий захист - уважний перегляд. Варто звертати увагу на спотворений текст, об'єкти, що зникають, і рухи, що порушують закони фізики. І якщо ви все ж іноді потрапляєте на фейк - не варто звинувачувати себе: навіть експерти не завжди можуть розпізнати підробку.

Нагадаємо, що великі корпорації, такі як McDonald's і Coca-Cola, знову опинилися в центрі скандалу через рекламні ролики на основі ШІ.

Читайте також про головні технологічні тренди 2025 року.

А ще ми писали, що експерти перевірили, чи здатний штучний інтелект обходити захист і створювати віруси.

Інструмент Content Authenticity Initiative (фото: CNET)

Обмеження методу

Як і будь-які детектори ШІ, цей інструмент не ідеальний. Відео, створені іншими сервісами, наприклад Midjourney, можуть не містити потрібних метаданих. Крім того, якщо ролик Sora був оброблений стороннім додатком і повторно збережений, ймовірність його коректного розпізнавання знижується.

Проте перевірка метаданих залишається одним із найефективніших способів відрізнити реальне відео від діпфейка в епоху стрімкого розвитку ШІ.

Шукайте маркування ШІ і вказуйте його самостійно

У соціальних мережах компанії Meta - таких як Instagram і Facebook - користувачі можуть отримати додаткову підказку про те, чи є контент згенерованим ШІ. У Meta є внутрішні системи, які відзначають подібні матеріали спеціальними мітками. Ці механізми не ідеальні, але у позначених публікацій можна побачити відповідну позначку. Аналогічні правила маркування ШІ-контенту діють і на платформах TikTok і YouTube.

При цьому єдиний по-справжньому надійний спосіб зрозуміти, що контент створений штучним інтелектом, - це пряма вказівка автора. Багато соцмереж уже пропонують налаштування, що дають змогу позначати публікації як згенеровані ШІ. Навіть просте пояснення в підписі до посту допомагає аудиторії зрозуміти, яким чином було створено матеріал.

Поки користувач гортає стрічку Sora, він розуміє, що перед ним - вигадка. Однак після виходу за межі застосунку і публікації АІ-відео на інших платформах відповідальність за розкриття походження контенту стає спільною.

У міру того як такі моделі, як Sora, дедалі сильніше стирають межу між реальністю і вигаданим, саме користувачі повинні робити максимально прозорим походження відео - реальне воно чи створене ШІ.

Головне - зберігати пильність

Не існує універсального способу з першого погляду точно визначити, чи є відео реальним, чи згенерованим ШІ. Найкраще, що можна зробити, - не вірити беззастережно всьому, що ви бачите в інтернеті. Якщо щось здається підозрілим або "неприродним", найімовірніше, так воно і є.

В умовах, коли мережа заповнюється ШІ-контентом сумнівної якості, найкращий захист - уважний перегляд. Варто звертати увагу на спотворений текст, об'єкти, що зникають, і рухи, що порушують закони фізики. І якщо ви все ж іноді потрапляєте на фейк - не варто звинувачувати себе: навіть експерти не завжди можуть розпізнати підробку.

Нагадаємо, що великі корпорації, такі як McDonald's і Coca-Cola, знову опинилися в центрі скандалу через рекламні ролики на основі ШІ.

Читайте також про головні технологічні тренди 2025 року.

А ще ми писали, що експерти перевірили, чи здатний штучний інтелект обходити захист і створювати віруси.